Yapay Sinir Ağlarında Transfer Fonksiyonları

9- Softmax (Soft Max Transfer Function)

İçindekiler

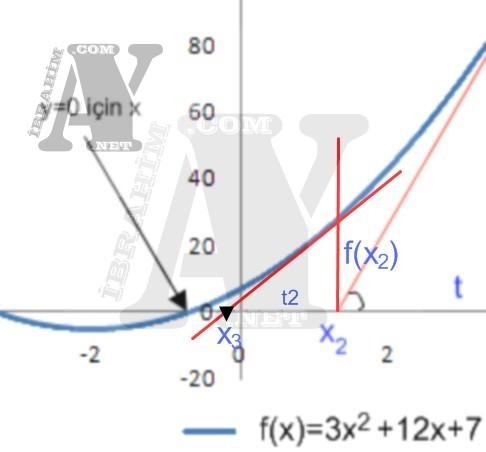

Denklemimiz:

softmax(n) = exp(n)/sum(exp(n))

Bu fonksiyonda sum (toplam) ifadesinde görüldüğü gibi bütün girdiler devreye girmektedir. Dolayısıyla softmax(n) ifadesini tek başına kullanırsak her zaman 1 değerini verecektir. Yani softmax(0), softmax(10), softmax(-1) vs vs sorgularsak her zaman 1 sonucunu alırız. Sağlamalı bir inceleme yapmadım ama formülden anlaşıldığı kadarıyla, ağ kurarken bu fonksiyonu kullandığımızda bütün girdilerin e üssünü alacak ve her birini bu değerlerin toplamına bölecektir. 1 sütunlu 5 satırlı bir setten örnek vermem iyi olacak gibi.

| n | exp(n) | exp(n)/sum(exp(n)) | |

|---|---|---|---|

| 3 | 20,086 | 20,086/26,620= | 0,75455 |

| -2 | 0,135 | 0,135/26,620= | 0,00507 |

| 1,3 | 3,669 | 3,669/26,620= | 0,13783 |

| -5 | 0,011 | 0,011/26,620= | 0,00041 |

| 1 | 2,718 | 2,718/26,620= | 0,10210 |

| ? | 26,620 | ||

Görüldüğü gibi bu veri setinde n=3 iken softmax fonksiyonu ile alınan çıktı 0,75455; -5 için 0,0004’tir. Vs vs